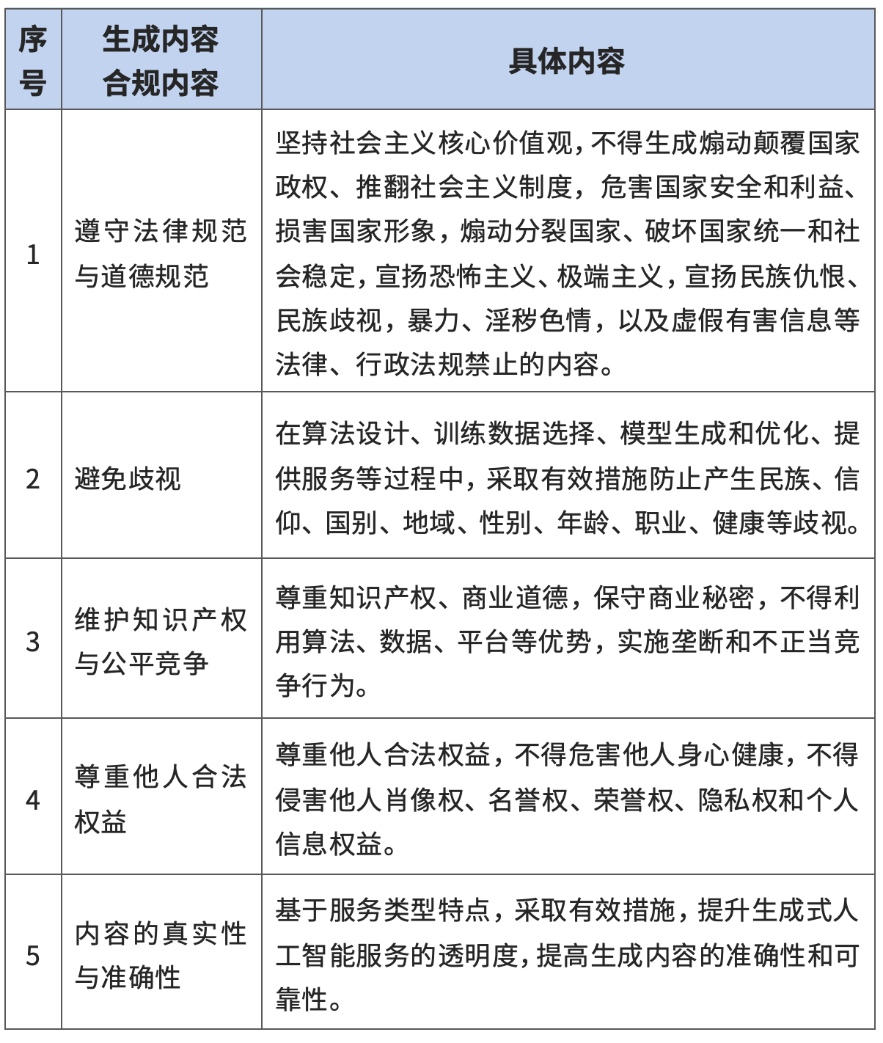

上文旨在探讨中国大模型领域的合规要素,首先解释了大模型的概念,重点分析了大模型在训练和应用过程中的主要合规风险以及技术方在数据处理时涉及到的风险。本篇内容将详细分析关于大模型的生成合规风险以及数据安全保护的内容,从运营方的角度进行风险分析,并进行上下篇全文的总结,梳理更清晰脉络方便读者理解。 一、大模型的生成合规风险以及数据安全风险(运营方风险) 根据《AIGC暂行办法》第四条,大模型的生成内容合规包含以下几个方面: (一)生成合规风险 大模型可能会生成虚假信息与误导性内容,也可能会输出偏见和歧视性言论,此类信息可能会对引发社会争议或风险。并且,大模型生成内容中很可能包含隐私推断的内容,即大模型可能会根据输入的信息和已有的知识,生成包含个人隐私的内容,即使训练数据中未明确包含这些隐私信息,也可能通过推理和联想得出,进而造成隐私风险。 (二)数据安全风险 1 数据泄露风险 大模型的训练数据往往包含海量的用户信息、企业数据以及各类敏感内容。一旦数据存储系统遭受黑客攻击,如网络犯罪分子利用软件漏洞突破防线,就可能导致这些数据被窃取并泄露到外部。例如, 2015年网易邮箱服务曾被曝出存在安全漏洞,导致部分用户邮箱账号被盗用,发送垃圾邮件等。黑客可能是通过利用邮箱系统的漏洞,获取了用户的账号权限,进而导致用户的邮件内容等隐私数据被泄露,给用户带来了诸多困扰,如个人隐私曝光、商业机密泄露等风险,也反映出网易在邮箱安全防护体系方面存在被新型攻击手段攻破的情况 。还有2017年,Equifax数据库被黑客入侵,暴露了超过1.43亿美国人的个人信息。该公司被控未能实施足够的数据安全措施,包括未能及时修补系统中已知的漏洞。2019年,Equifax被联邦贸易委员会(FTC)处以7亿美元罚款。 此外,运营方内部管理不善也是数据泄露的重要隐患。若内部人员权限管理混乱,个别违规员工可能会出于私利故意窃取数据,或者因操作失误导致数据意外泄露。 2 数据篡改风险 在数据传输或存储过程中,大模型的数据可能面临被恶意篡改的风险。网络攻击者可能会拦截数据传输通道,对数据进行修改,从而使大模型基于错误的数据进行学习和决策。比如在金融领域的大模型应用中,如果交易数据被篡改,可能会导致错误的交易指令生成,引发金融市场的混乱和用户资产的损失。而且,一些恶意软件也可能入侵数据存储设施,悄无声息地对数据进行篡改,而这种篡改在未被发现前可能会持续影响大模型的准确性和可靠性,使其输出错误的结果或预测。 3 数据滥用风险 大模型的数据可能被用于非法或不当的目的。一方面,运营方可能违反数据使用协议,将数据用于未经授权的商业用途或与第三方共享以谋取利益。例如,某些医疗大模型所收集的患者健康数据,若被不法企业获取并用于精准营销或出售给其他商业机构,将严重侵犯患者的隐私权和权益。另一方面,数据也可能被用于恶意的社会工程攻击,如通过分析大量用户数据来制定针对性的诈骗策略,使诈骗分子能够更精准地欺骗用户,导致用户遭受经济损失或个人信息进一步被泄露。 二、运营方的合规义务 1 资质证照 运营方需要取得增值电信业务经营许可证(ICP证),并进行安全评估和算法备案。 2 内容合规 用户输入数据合规:需对用户输入数据进行审核,识别违法和不良信息。 3 服务生成内容合规 需保证服务生成内容合规,承担审核义务,建立健全内容治理机制,设立辟谣机制和违法不良信息识别特征库。 4 知识产权保护 需履行“通知-删除”义务,防止知识产权侵权。 5 平台管理合规 包括指导、保护用户义务,稳定服务义务,违法整改义务,建立健全投诉举报机制义务。 6 数据来源合规 需对模型的数据来源合法性进行审查,对技术支持方数据安全保护能力开展尽职调查。 7 网络安全 需遵守网络安全相关法律法规。 8 数据安全 需履行数据安全保护义务,包括数据分类分级、安全管理制度、风险监测、风险评估等。 9 个人信息保护 需遵守《个人信息保护法》等法律法规,保护个人信息安全,特别是跨境传输问题。 10 国际联网合规 需租赁使用合规的国际专线。 结语 《暂行办法》实施背景下,大模型合规要素繁多拢杂。大模型是基于深度学习技术的复杂模型,其应用广泛且涉及大量数据处理。因此,数据合规成为关键问题。在大模型的训练阶段,合规风险主要集中在知识产权侵权和数据来源合法性方面。此外,大模型在生成内容时需确保数据的真实性和多样性,以避免误导用户。 为了确保合规,企业需要进行大模型备案,并提交安全评估报告等材料。这一过程不仅涉及技术合规,还包括内容、平台运营和网络安全等多个方面的合规要求。 从现状来看,大模型的发展虽然带来了技术进步和应用便利,但也引发了隐私泄露、数据安全等法律和伦理问题。因此,建立完善的法律监管框架和加强行业自律是推动大模型健康发展的必要条件。